Qwen-Image:阿里云通义千问团队开源的图形海报生成模型

Qwen-Image 是阿里通义千问团队在 2025 年 8 月 5 日开源的图像生成基础模型,参数规模 200 亿,采用 MMDiT 架构。它在复杂文本渲染和精准图像编辑方面表现突出,尤其擅长生成大量精准的中文,也支持中文提示词,在 LongText-Bench、ChineseWord 等中文专项测试中领先很多。

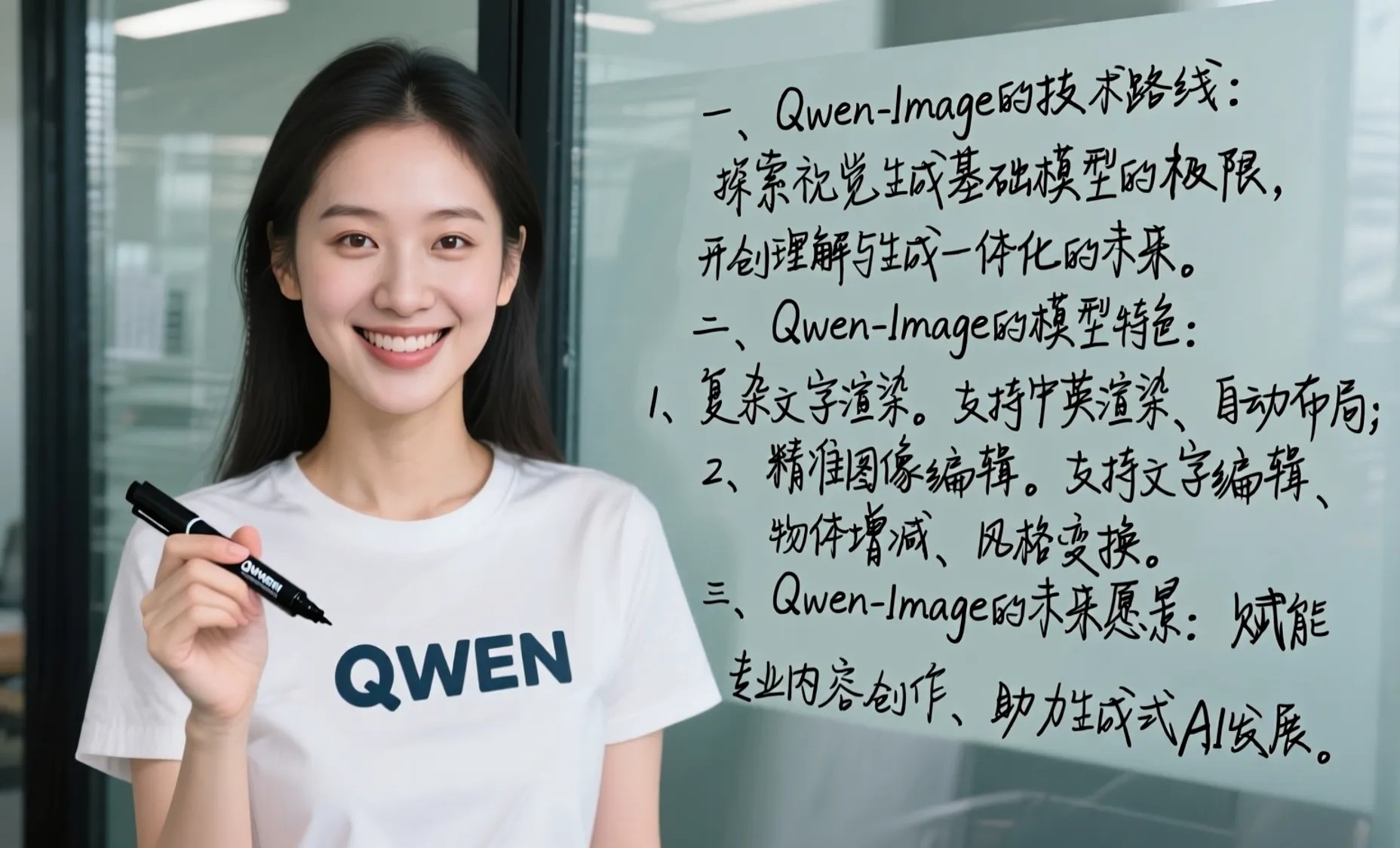

这个模型支持中英双语,能处理不同字体、超长段落和复杂的图文布局,可生成海报、ppt 等多种场景的图像,还能进行风格迁移、增减物体、调整姿态等图像编辑。它能应用在广告设计、影视制作、游戏开发、教育培训等多个行业。用户可以在 QwenChat(chat.qwen.ai)里选图像生成功能来体验,既能生成海报、PPT 页面、商品宣传图等,也能对图像做各种编辑,给设计师提供了有力工具。

主要特性

文本渲染能力强:支持多行布局、段落级文本生成和细节呈现,中英文都能高保真输出,在 LongText-Bench、ChineseWord 和 TextCraft 等测试中表现很好,中文文本渲染比现有先进模型好很多,能生成不同语种、风格的文字,还能写毛笔字,或者直接生成带文本和图像的 PPT 页面。

图像编辑一致性好:通过加强的多任务训练,编辑时能保持视觉和语义上的连贯,支持风格迁移、增删改、细节增强、文字编辑、调整人物姿态等操作。

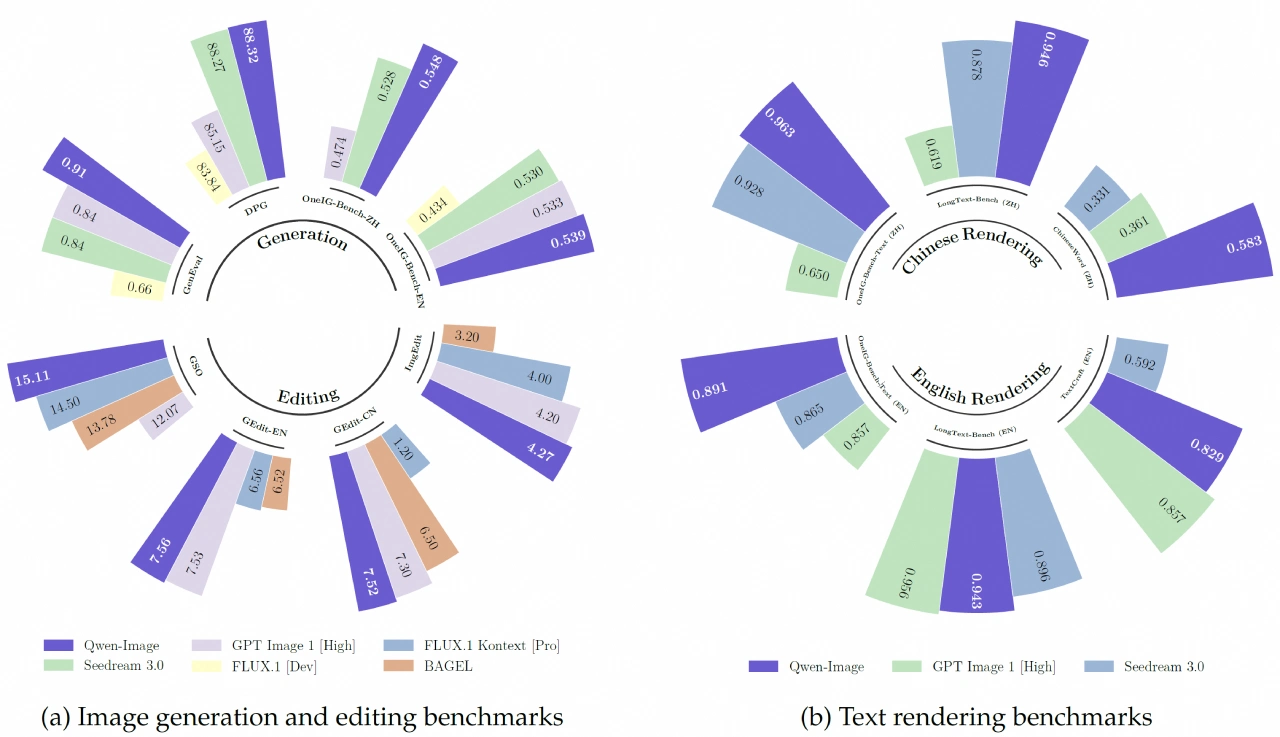

跨基准性能佳:在通用图像生成的 GenEval、DPG 和 OneIG-Bench,以及图像编辑的 GEdit、ImgEdit 和 GSO 等多个公开测试中,都取得了顶尖性能。

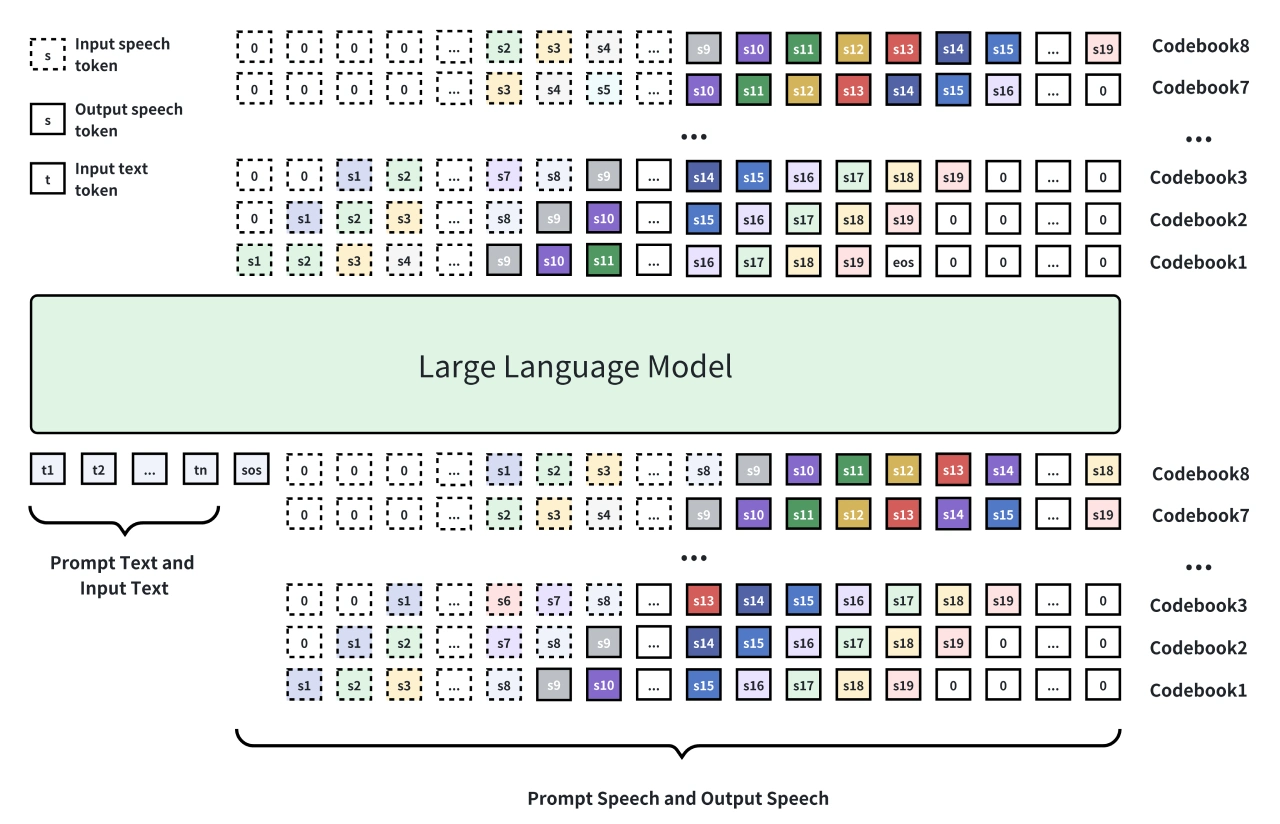

核心组件

Qwen2.5-VL 多模态大语言模型:作为条件编码器,从文本中提取特征,根据系统提示详细描述物体和背景的颜色、数量、文字等,为图像生成提供依据,让生成的内容更精细。

Wan-2.1 视频生成模型的分自编码器(VAE):相当于图像分词器,能把输入图像压缩成紧凑的潜在表示,推理时再解码还原。团队冻结了编码器,只微调解码器,让图像细节更突出。

多模态扩散 Transformer(MMDiT):作为主干扩散模型,在文本引导下处理噪声和图像潜在表示的关系,加入多模态可扩展 RoPE 方法,帮助区分图像和文本信息,既能生成高分辨率图像,又能准确生成文字。

Qwen-Image技术架构

MMDiT 架构:用多模态扩散变换器,实现文本和图像的深度融合。

单编码器双解码器的 VAE:负责把图像压缩成紧凑的潜在表示,生成后再解码成像素。通过调整重建损失和感知损失的平衡,能逼真还原图像细节。

多模态可扩展旋转位置编码(MSRoPE):把文本信息在图像网格的 “对角线” 上编码,既保持文本独立性,又能利用图像分辨率缩放的优势。

训练策略

采用多阶段、渐进式的预训练:从低分辨率到高分辨率,从通用内容到专门内容,从海量数据到精炼数据逐步训练。

训练后期用监督微调(SFT)和强化学习(RL):用人工精选的高质量数据微调,还通过 DPO 等技术让模型学习人类偏好。

应用场景

广告设计:根据品牌风格快速生成高质量图片,支持风格转换和细节优化,帮设计师快速试多种效果,满足客户需求。

影视制作:用于前期概念图、场景预设和角色设计,缩短制作周期,降低成本。

电商视觉:商家能快速生成产品展示图、虚拟试穿图和营销素材,提升用户体验和购买率。

海报制作:根据文字和设计要求生成有冲击力、艺术感的海报(如电影、活动海报),适配不同风格和主题。

PPT制作:生成企业级PPT页面,采用星空蓝主色调,搭配流动科技线条和微光粒子特效,画面专业现代,支持多种风格和布局。

性能表现

通用图像生成:在 GenEval、DPG 和 OneIG-Bench 等测试中表现优秀。

图像编辑:在 GEdit、ImgEdit 和 GSO 等专业测试中性能顶尖。

文本渲染:在 LongText-Bench、ChineseWord 和 TextCraft 等测试中能力突出,尤其中文文本渲染远超现有顶尖模型。

Qwen-Image优势

中文支持更好:专门优化中文,渲染效果比 DALL-E 好很多。

完全免费:不用付费订阅,还能在本地部署。

开源透明:代码公开,可自定义修改。

编辑功能更强:支持更多样的图像编辑操作。

无使用限制:不受 API 调用次数限制。

Qwen-Image使用方法

环境准备:安装最新版本的 diffusers。

基础代码:

from diffusers import DiffusionPipeline

import torch

model_name = "Qwen/Qwen-Image"

if torch.cuda.is_available():

torch_dtype = torch.bfloat16

device = "cuda"

else:

torch_dtype = torch.float32

device = "cpu"

pipe = DiffusionPipeline.from_pretrained(model_name, torch_dtype=torch_dtype)

pipe = pipe.to(device)

prompt = '''一个穿着"QWEN"标志T恤的中国美女正拿着黑色马克笔面向镜头微笑。她身后的玻璃板上手写体写着"欢迎使用Qwen-Image,一款强大的图像基础模型"'''

aspect_ratios = {

"1:1": (1328, 1328),

"16:9": (1664, 928),

"9:16": (928, 1664),

"4:3": (1472, 1140),

"3:4": (1140, 1472)

}

width, height = aspect_ratios["16:9"]

image = pipe(

prompt=prompt + "超清,4K,电影级构图",

width=width,

height=height,

num_inference_steps=50,

true_cfg_scale=4.0,

generator=torch.Generator(device=device).manual_seed(42)

).images[0]

image.save("qwen_image_example.png")硬件要求:推荐用 NVIDIA GPU(8GB 以上显存),CPU 模式生成速度较慢,但也能使用。

✅Qwen-Image官方介绍:https://qwenlm.github.io/zh/blog/qwen-image/

✅Qwen-Image模型:https://huggingface.co/Qwen/Qwen-Image

✅在线使用:https://chat.qwen.ai/(选输入框下面的图像生成)

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 FastbuildAI

FastbuildAI