HRAvatar:单目生成高质量3D头像方法

在数字人、虚拟主播、AR/VR等领域快速发展的背景下,高效生成真实、可动、可重光照的3D头像成为关键需求。然而,从单目视频中生成高度逼真的可动画化头像仍面临诸多挑战,现有基于3D高斯(3DGS)的方法在重建质量上存在一些限制,如几何变形灵活性不足、表情追踪不准确、无法实现真实重光照等。

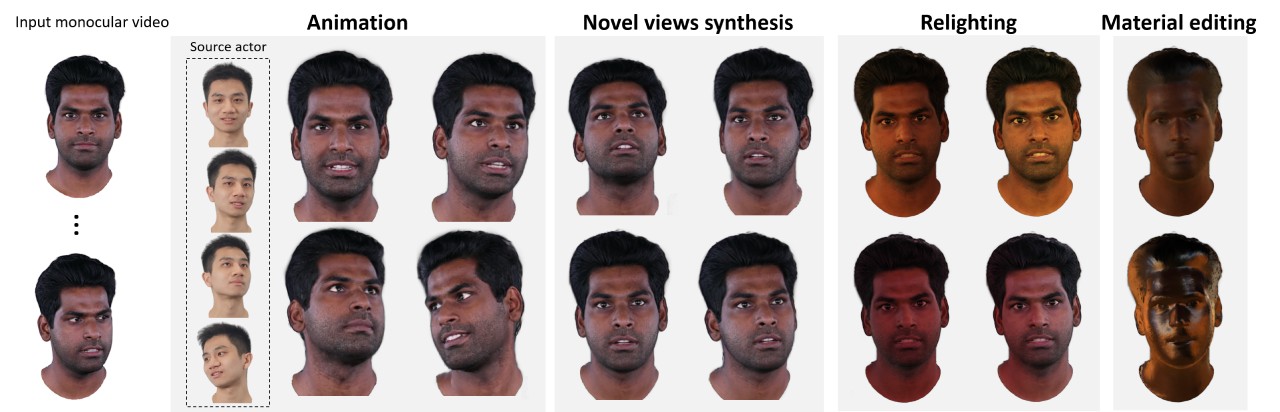

清华大学与IDEA团队合作,开发出HRAvatar——一种利用单目视频创建高质量、可重光照3D头像的新技术。它借助可学习的形变基和线性蒙皮,实现个性化几何变形,同时配备精准的表情编码器,降低追踪误差,提升重建品质。HRAvatar在实时性与细节呈现上表现出色,已被CVPR2025会议收录。实验表明,其在多项评估指标上优于现有技术,实时性能约155 FPS,还支持在新光照环境下进行重光照。

HRAvatar的核心技术

可学习形变基和线性蒙皮技术:通过自适应学习每个点的形变基与混合蒙皮权重,实现高斯点从标准姿态到各种表情和姿态的灵活变形,解决通用参数模型难以准确捕捉个性化表情变化的问题。

精准的表情编码器:引入端到端的表情编码器,与3D头像重建联合优化,利用高斯重建损失进行监督,减少追踪误差,提升重建质量。

外观建模与物理着色:将头像外观分解为反照率、粗糙度、菲涅尔反射等材质属性,引入反照率伪先验以更好解耦材质信息,使用简化的BRDF物理模型进行着色,并引入SplitSum近似技术对环境光照图进行预计算,实现高质量、可重光照的实时渲染。

HRAvatar的技术优势

重建质量高:在所有评估指标上都优于现有方法,特别是在LPIPS上,重建的头像细节更丰富。

实时性能好:渲染速度达到约155FPS,满足实时性要求。

HRAvatar重建的头像不仅可以进行驱动,还可以在新的环境光图下进行重光照或简单的材质编辑,适用于电影、游戏、沉浸式会议、AR/VR等领域。

项目相关链接

论文地址:https://arxiv.org/pdf/2503.08224

项目主页:https://eastbeanzhang.github.io/HRAvatar/

开源代码:https://github.com/Pixel-Talk/HRAvatar

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 开源AI应用平台

开源AI应用平台