KDTalker:根据输入的音频信号生成逼真的面部表情和动作视频

KDTalker是什么?

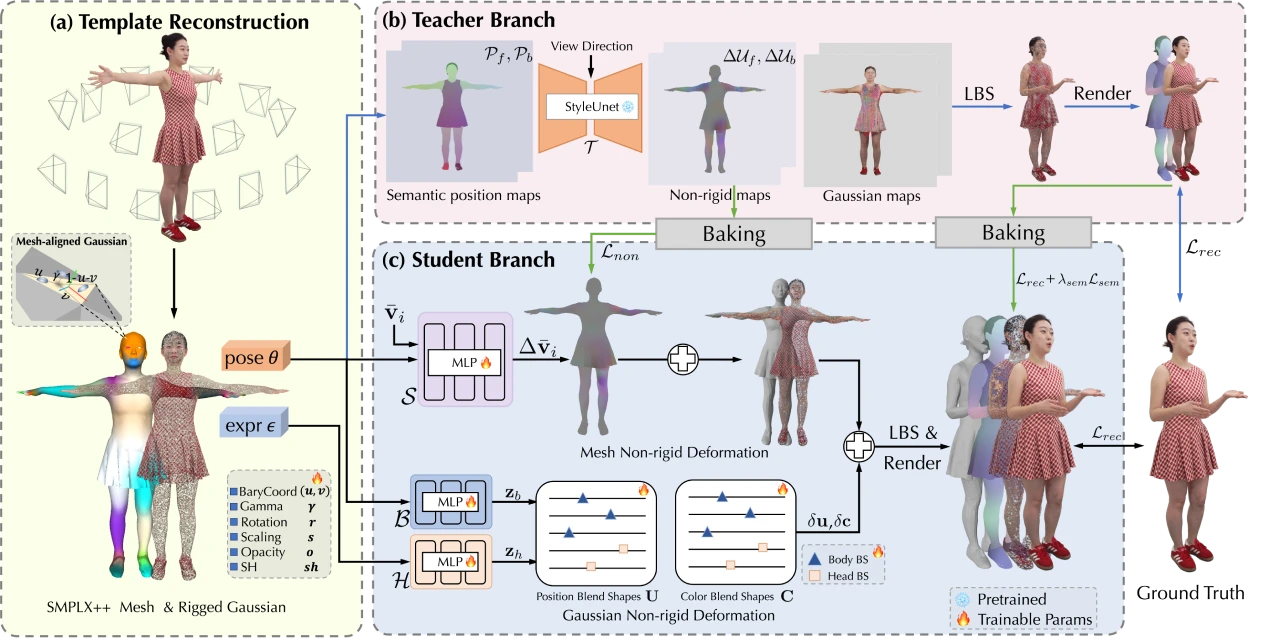

KDTalker 是一个音频驱动动态肖像生成工具,能够根据输入的音频信号生成逼真的面部表情和动作。KDTalker 具有隐式关键点技术、时空扩散模型和姿势多样性等特点。适用于虚拟现实、社交媒体、视频会议等多种场景。通过简单的环境准备和命令行操作,用户可以快速生成高质量的动态肖像视频。

KDTalker 功能特征

隐式关键点技术:

利用隐式关键点捕捉面部表情和动作的细微变化,能够更自然地反映音频与面部动作之间的关系。

与传统的显式关键点方法相比,隐式关键点可以避免显式标注的复杂性和误差。

时空扩散模型:

结合时空扩散模型,生成更加平滑和连贯的动态效果,同时保持图像质量和稳定性。

通过时空扩散模型,能够更好地处理视频序列中的时间连续性。

姿势多样性:

支持多种姿势的生成,能够根据音频内容动态调整人物的姿态,增加生成结果的多样性和自然性。

用户可以指定不同的姿势风格,生成更具个性化的动态肖像。

高效性:

优化的模型设计和高效的计算流程,使得该技术能够在单个RTX4090或RTX3090显卡上运行,具有较高的实用性和可扩展性。

适合在资源有限的设备上使用,同时保持较高的生成速度。

高质量生成:

生成的动态肖像具有较高的分辨率和逼真度,能够满足高质量视频生成的需求。

通过预训练模型和优化的推理流程,确保生成结果的稳定性和一致性。

KDTalker 应用场景

虚拟现实(VR)和增强现实(AR):

在VR和AR应用中,KDTalker可以生成逼真的虚拟角色动态肖像,提升用户体验。

例如,在虚拟会议中,用户可以通过音频驱动生成自己的动态肖像,使远程交流更加自然。

社交媒体和视频内容创作:

用户可以将自己的照片和音频输入KDTalker,生成个性化的动态肖像视频,用于社交媒体分享。

内容创作者可以利用该技术生成有趣的视频内容,增加视频的吸引力。

视频会议:

在视频会议中,网络不稳定可能导致视频卡顿或模糊。KDTalker可以通过音频驱动生成流畅的动态肖像,即使在低带宽环境下也能保持良好的视觉效果。

娱乐和游戏:

在游戏和娱乐应用中,KDTalker可以生成虚拟角色的动态表情和动作,增强游戏的沉浸感。

例如,在角色扮演游戏中,玩家可以通过音频驱动生成自己的角色动态肖像。

教育和培训:

在教育和培训场景中,KDTalker可以生成教师或培训师的动态肖像,用于在线课程或培训视频。

通过音频驱动生成的动态肖像可以使教学内容更加生动,提高学习效果。

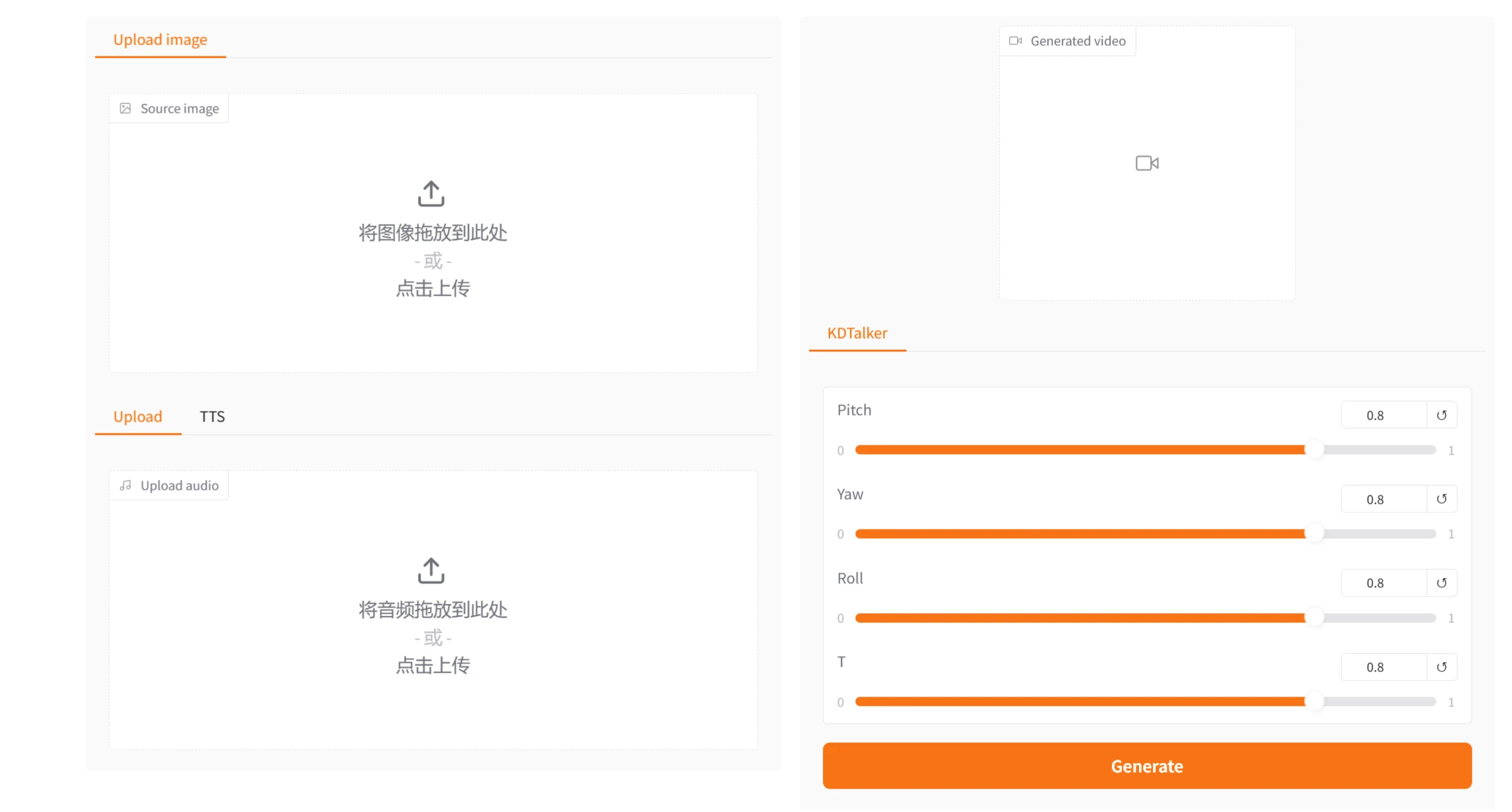

KDTalker 使用方法

1. 环境准备

硬件要求:推荐使用RTX4090或RTX3090显卡。

软件依赖:

安装git、conda和FFmpeg。

克隆代码并创建Python环境:

git clone https://github.com/chaolongy/KDTalker cd KDTalker # 创建并激活conda环境 conda create -n KDTalker python=3.9 conda activate KDTalker # 安装PyTorch和其他依赖 conda install pytorch==2.3.0 torchvision==0.18.0 torchaudio==2.3.0 pytorch-cuda=11.8 -c pytorch -c nvidia pip install -r requirements.txt

2. 下载预训练权重

从Google Drive或Hugging Face下载预训练权重文件,并放置到./pretrained_weights和./ckpts目录中。

确保目录结构如下:

pretrained_weights ├── insightface │ └── models │ └── buffalo_l │ ├── 2d106det.onnx │ └── det_10g.onnx └── liveportrait ├── base_models │ ├── appearance_feature_extractor.pth │ ├── motion_extractor.pth │ ├── spade_generator.pth │ └── warping_module.pth ├── landmark.onnx └── retargeting_models └── stitching_retargeting_module.pth

3. 运行推理

使用以下命令运行推理脚本,生成动态肖像视频:

python inference.py -source_image ./example/source_image/WDA_BenCardin1_000.png -driven_audio ./example/driven_audio/WDA_BenCardin1_000.wav -output ./results/output.mp4

-source_image:指定输入的源图像路径。

-driven_audio:指定输入的驱动音频路径。

-output:指定输出视频的保存路径。

项目地址:https://github.com/chaolongy/KDTalker

DEMO:https://kdtalker.com/

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 开源AI应用平台

开源AI应用平台