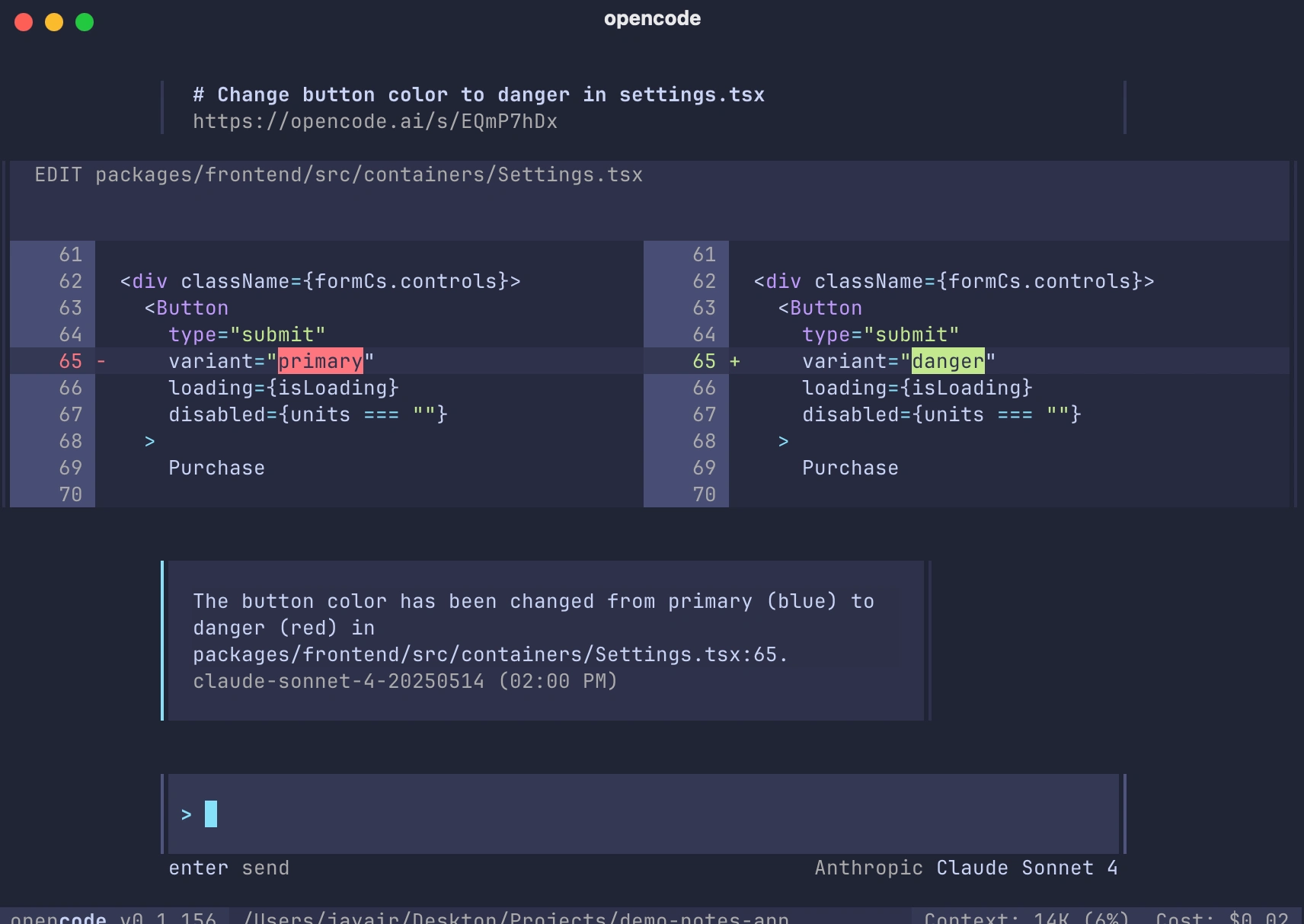

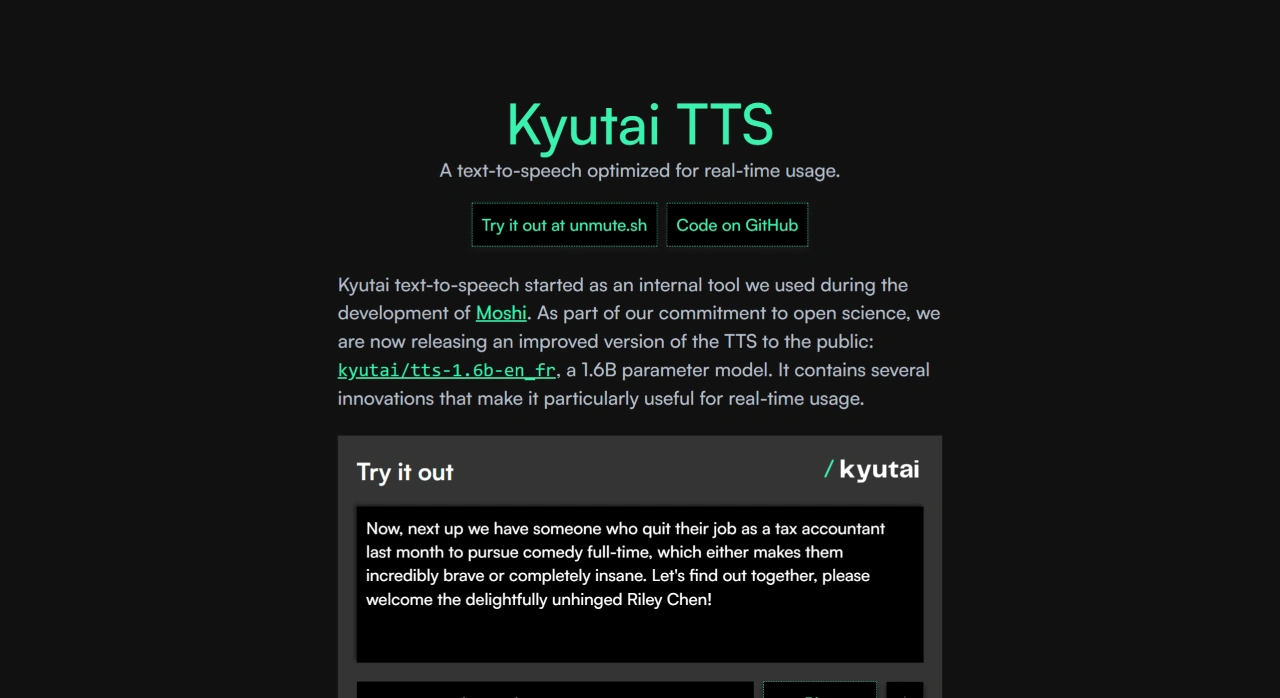

Kyutai TTS:专为实时场景设计的开源文本转语音工具

Kyutai TTS 是法国 Kyutai Labs 开发的开源文本转语音模型,专为实时应用设计。它有 1.6B 参数,英语和法语的字错误率分别是 2.82% 和 3.29%,语音生成延迟仅 220 毫秒,适合直播和语音助手等场景。其流式处理和延迟流建模技术让文本和语音生成更高效。

技术特点:

流式处理与低延迟:Kyutai TTS 可在接收到第一个文本标记后立即生成音频,延迟仅 220 毫秒。在 NVIDIA L40S GPU 上处理 32 个请求时,延迟约 350 毫秒。

高精度语音输出:英语和法语的单词错误率分别为 2.82% 和 3.29%,说话者相似度分别达 77.1% 和 78.7%,语音自然且接近原始样本。

长篇内容生成:能处理长篇文章,突破了传统 TTS 模型的 30 秒限制。

语音克隆:用户提供 10 秒音频样本,模型可匹配说话者的音色、语调等。为确保合法性,Kyutai TTS 基于公开数据集提供声音库,不直接发布语音嵌入模型。

单词时间戳:生成的音频中每个单词都有精确时间戳,便于实时字幕生成或交互式应用。

架构与训练:

延迟流建模(DSM):模型在接收文本时可实时生成语音,支持流式文本输入,能同时处理多个请求。

训练数据与硬件:使用 250 万小时公开音频数据训练,由 Whisper 生成转录文本,训练过程使用了 32 个 H100 GPU。

应用场景:

实时交互:适用于虚拟助手、在线教育平台和实时字幕生成。

内容创作:可用于生成播客、有声书等长篇内容。

辅助工具:为视障人士提供高质量的文本朗读服务。

同其它TTS对比:

与市场上其他 TTS 模型相比,Kyutai TTS 在单词错误率和说话者相似度方面表现出色,尤其在实时交互场景中表现优异。

Kyutai TTS 以 CC-BY-4.0 许可证开源,源码和权重可在 GitHub 和 Hugging Face 上找到。开发者可通过捐赠声音数据帮助模型扩充语音风格和语言支持。

项目地址:https://kyutai.org/next/tts

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 开源AI应用平台

开源AI应用平台